شبکه اطلاعرسانی روابطعمومی ایران (شارا) || در مواجهه با پیشرفتهای سریع فناوری هوش مصنوعی، گروهی از دانشمندان برجسته خواستار ایجاد یک سیستم نظارتی جهانی برای کنترل و مهار خطرات این فناوری شدند. این فراخوان در پی پیشرفتهایی مانند ChatGPT و دیگر سرویسهای مشابه مطرح شده است که قابلیت تولید متن و تصاویر را دارند و نشاندهنده قدرت هوش مصنوعی در عرصههای مختلف هستند.

هوش مصنوعی به سرعت از یک فناوری نوپا به یکی از ابزارهای روزمره در گوشیهای هوشمند، خودروها و کلاسهای درس تبدیل شده است. این پیشرفتها دولتها را از واشنگتن تا پکن مجبور کرده تا برای تنظیم و نظارت بر این فناوری چارهای بیاندیشند.

دانشمندان هشدار دادند که فناوریهای جدید هوش مصنوعی ممکن است ظرف چند سال به سطحی از پیشرفت برسند که از توان کنترل سازندگان آنها فراتر روند. نگرانی اصلی آنها این است که این فناوریها میتوانند به طور مستقل توسعه یابند و در نهایت باعث “از دست دادن کنترل انسانی” شوند. دکتر گیلیان هادفیلد، محقق حقوقی و استاد علوم کامپیوتر از دانشگاه جان هاپکینز، بر این باور است که اگر مدلهای هوش مصنوعی بتوانند به طور خودمختار به توسعه بپردازند، هیچ چارچوب جهانی برای مدیریت این وضعیت وجود ندارد.

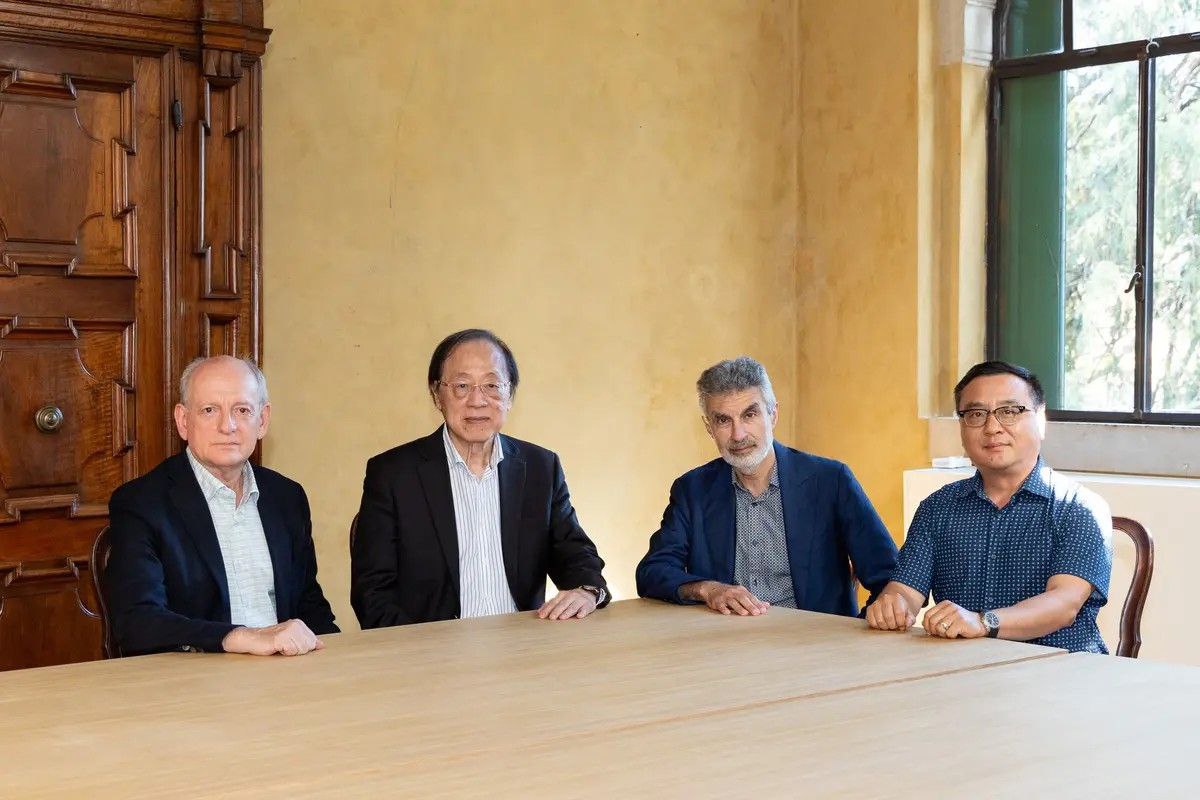

در 5 تا 8 سپتامبر، دانشمندان سراسر جهان در شهر ونیز گرد هم آمدند تا در سومین نشست بینالمللی گفتگوهای ایمنی هوش مصنوعی به بررسی این موضوع بپردازند. این نشست توسط گروه تحقیقاتی Far.AI از ایالات متحده برگزار شد و پیشنهاد کرد که دولتها باید مرجعی برای ثبت و نظارت بر سیستمهای هوش مصنوعی ایجاد کنند. این مقامات ملی سپس میتوانند با یکدیگر همکاری کنند تا بر سر خطوط قرمز مشترک و علائم هشدار به توافق برسند، از جمله محدودیتهایی بر روی کپی خودکار سیستمهای هوش مصنوعی.

در این نشست، دانشمندانی از کشورهای ایالات متحده، چین، بریتانیا، کانادا، و سنگاپور حضور داشتند. یوشوا بنجیو، یکی از پدران بنیانگذار هوش مصنوعی و برنده جایزه تورینگ، یکی از امضاکنندگان این بیانیه بود. همچنین جفری هینتون، دیگر دانشمند برجسته هوش مصنوعی، از راه دور در این نشست شرکت کرد.

هرچند این گفتگوها در سایه رقابت تکنولوژیکی بین ایالات متحده و چین انجام شد، اما دانشمندان تأکید کردند که این تبادلات علمی باید برای جلوگیری از وقوع فاجعههای بالقوه ناشی از هوش مصنوعی ادامه یابد. مقایسهای که از دوران جنگ سرد و هماهنگی دانشمندان برای جلوگیری از فاجعه هستهای صورت گرفته است، نشان میدهد که چگونه میتوان از تجربههای گذشته برای جلوگیری از خطرات هوش مصنوعی بهره گرفت.

نویسنده: میگان توبین

تاریخ انتشار: 16 سپتامبر 2024

منبع انگلیسی: New York Times

منبع فارسی: شارا

انتهای پیام/

با کلیک روی لینک زیر به کانال تلگرام ما بپیوندید:

<div id=”div_eRasanehTrustseal_24429″></div>

<script src=”https://trustseal.e-rasaneh.ir/trustseal.js”></script>

<script>eRasaneh_Trustseal(24429, false);</script>

نظر بدهید