این مقاله نشان میدهد شکاف ایدئولوژیک در اوپنایآی چگونه به تمرکز قدرت منجر شده است. روایتهای افراطی خوشبینی و هراس، کنترل محدود فناوری را طبیعی جلوه میدهند.

فرهنگ سازمانی بسته، نقد بیرونی را تضعیف کرده است. مسائل واقعی اجتماعی و اقتصادی در سایه این روایتها نادیده گرفته میشوند.

با این حال، اعتراضهای مدنی و حقوقی در حال گسترش است. این فشارها میتوانند مسیر توسعه هوش مصنوعی را تغییر دهند. آینده به میزان مشارکت جامعه در حکمرانی فناوری وابسته است.

نویسنده: تیم برینکهوف

تاریخ انتشار: ۲۷ آذر ۱۴۰۴

منبع: بیگ تینک

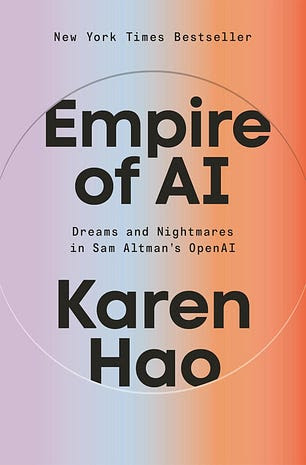

شبکه اطلاعرسانی روابطعمومی ایران (شارا) || کارن هائو، روزنامهنگار باسابقه حوزه فناوری، در کتاب خود با عنوان «امپراتوری هوش مصنوعی» نشان میدهد که بحران مدیریتی اوپنایآی در سال ۱۴۰۲ صرفاً یک تنش مدیریتی یا اختلاف فردی نبود، بلکه نتیجه شکافی عمیق و ایدئولوژیک درون این سازمان بود. شکافی که ریشه در دو نگاه افراطی به آینده هوش مصنوعی دارد و هر دو، بهگونهای متفاوت، به تمرکز قدرت و تضعیف پاسخگویی اجتماعی منجر شدهاند.

در زمان برکناری موقت مدیرعامل اوپنایآی، هدف بنیادین سازمان مورد اختلاف نبود. همه بر این باور بودند که هوش مصنوعی پیشرفته باید در خدمت بشریت باشد و نه تهدیدی برای آن. اختلاف اصلی بر سر مسیر تحقق این هدف شکل گرفت. یک جریان معتقد بود که توسعه هوش مصنوعی پیشرفته نیازمند منابع مالی عظیم است و این منابع فقط از طریق ورود سرمایهگذاری انتفاعی تأمین میشود. جریان مقابل هشدار میداد که تجاریسازی، مأموریت اخلاقی سازمان را تضعیف میکند و آن را از هدف اولیه منحرف خواهد ساخت. در نهایت، مسیر تجاریسازی پیروز شد و ساختار سازمان تغییر یافت.

بهگفته هائو، اوپنایآی از ابتدا تنها بر پایه دغدغههای بشردوستانه بنا نشد. در کنار نگرانیهای واقعی درباره آینده تمدن، انگیزه رقابت و میل به سلطه بر میدان هوش مصنوعی نیز نقشی جدی داشت. روایت «نجات بشریت» به داستانی قدرتمند تبدیل شد که هم کارکنان را بسیج کرد، هم سرمایهگذاران را جذب نمود و هم بسیاری از انتقادهای عمومی را خنثی ساخت. این روایت، در عمل، به ابزاری برای مشروعیتبخشی به رشد سریع و کممهار تبدیل شد.

هائو فرهنگ درونی اوپنایآی را دارای ویژگیهای شبهاعتقادی توصیف میکند. کارکنان در فضایی کار میکردند که در آن بهطور مداوم تأکید میشد هدف نهایی آنقدر بزرگ است که هر هزینهای را توجیه میکند. چنین نگاهی، شباهت زیادی به منطق امپراتوریهای تاریخی دارد؛ امپراتوریهایی که با شعار تمدنسازی، تمرکز قدرت و بهرهکشی را طبیعی و ضروری جلوه میدادند.

در سالهای بعد، اوپنایآی بهتدریج از رویکرد باز و شفاف فاصله گرفت. سازمان بهجای گفتوگوی عمومی و پذیرش نقد، خود را در برابر بازخوردهای بیرونی مصون ساخت. هرچه تردیدها درباره دستاوردهای واقعی هوش مصنوعی افزایش یافت، این انزوا عمیقتر شد و روایتهای درونی تقویت شدند. بهجای بازنگری مسیر، تأکید بر درستی راه انتخابشده شدت گرفت.

یکی از محورهای اصلی تحلیل هائو، دوگانه «خوشبینان افراطی» و «هراسگرایان افراطی» است. خوشبینان هوش مصنوعی را ناجی بشریت میدانند و هراسگرایان آن را تهدیدی آخرالزمانی. هائو تأکید میکند که این دو روایت، با وجود تقابل ظاهری، در یک نقطه به هم میرسند: هر دو این تصور را تقویت میکنند که هوش مصنوعی اجتنابناپذیر، همهتوان و شایسته کنترل توسط گروهی محدود از نخبگان است.

این دوگانه افراطی، توجه افکار عمومی را از مسائل واقعی و فوری منحرف میکند. موضوعاتی مانند هزینههای سنگین زیستمحیطی مراکز داده، تأثیرات منفی بر سلامت روان، تشدید نابرابری اقتصادی و بیثباتی بازار کار در حاشیه قرار میگیرند. در چنین شرایطی، شرکتهای بزرگ فناوری میتوانند با توجیه «حفاظت از بشریت»، کنترل شدیدتر و تمرکز قدرت را ادامه دهند.

با این حال، هائو تصویر کاملاً تاریکی ترسیم نمیکند. او به نشانههای رو به رشد مقاومت اجتماعی اشاره میکند؛ از اعتراض به پروژههای عظیم دادهای گرفته تا شکایتهای حقوقی هنرمندان، نویسندگان و خانوادههایی که از پیامدهای روانی و اجتماعی فناوری آسیب دیدهاند. همچنین ائتلافهای مدنی در حال شکلگیری هستند که مدلهای متمرکز توسعه هوش مصنوعی را به چالش میکشند. بهنظر او، همین فشارهای اجتماعی میتواند مسیر آینده را کندتر، شفافتر و پاسخگوتر کند.

با کلیک روی لینک زیر به کانال تلگرام ما بپیوندید:

برای اطلاعات بیشتر درباره روابط عمومی و اخبار سازمانهای مختلف، میتوانید به وبسایت شارا مراجعه کنید.

انتهای پیام/

نظر بدهید