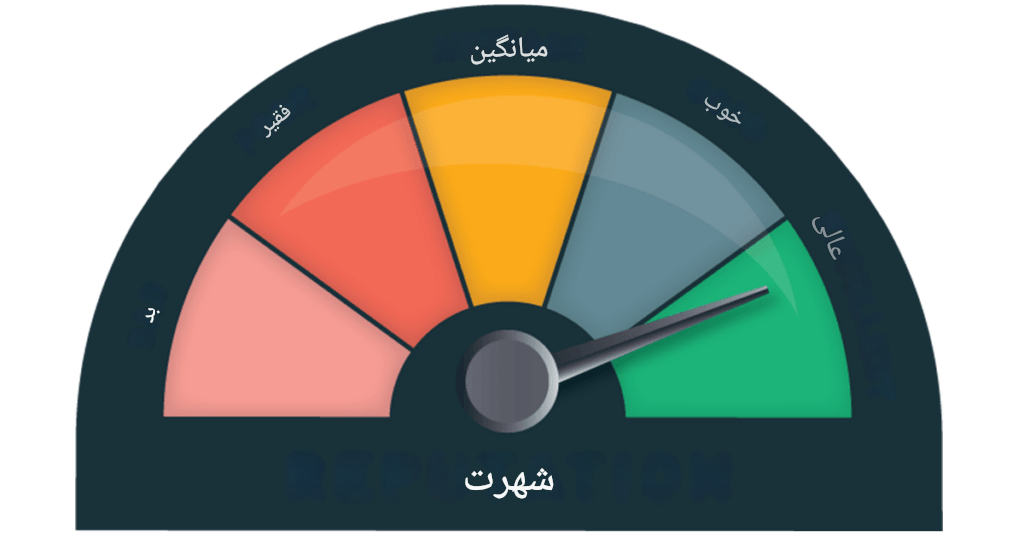

شبکه اطلاعرسانی روابطعمومی ایران (شارا) || الگوریتمها دیگر محدود به تیمهای مهندسی یا جزئیات قراردادهای فروشندگان فناوری نیستند. آنها اکنون در مرکز شهرت شرکتی قرار دارند. از نحوه ظاهر شدن یک شرکت در نتایج جستجو، رتبهبندی محتوا در رسانههای اجتماعی گرفته تا نحوه تصمیمگیری سیستمهای خودکار که مشتریان و کارکنان را تحت تأثیر قرار میدهند، الگوریتمها در حال شکلدهی به درک عمومی در زمان واقعی هستند. برای رهبران شرکتها و مدیران روابط عمومی، درک این تغییرات نه تنها ضروری است بلکه برای مدیریت ریسک، مسئولیت اخلاقی و اعتماد بلندمدت اهمیت دارد.

چگونه الگوریتمها بر شهرت شرکتی و اعتماد تأثیر میگذارند؟

الگوریتمها، به ویژه آنهایی که توسط هوش مصنوعیتقویت شدهاند، به طور فزایندهای مسئول فیلتر کردن، رتبهبندی و پیشنهاد محتوا هستند که درک عمومی از برند را شکل میدهند. این الگوریتمها تأثیر مستقیمی بر شهرت دارند. به عنوان مثال، یک مطالعه در سال 2022 توسط Deloitte نشان داد که 62% از مصرفکنندگان بیشتر احتمال دارد به شرکتی که در استفاده از هوش مصنوعی شفاف است اعتماد کنند.

مسئولیتپذیری در سیستمهای الگوریتمی

مسئولیتپذیری با شفافیت آغاز میشود. اگر مدیران اجرایی از نحوه عملکرد سیستمهای خود آگاه نباشند، نمیتوانند برای نتایج آنها مسئول باشند. اولین قدم ایجاد ساختارهای حکمرانی واضح است که تعیین کند چه کسی مسئول تصمیمات الگوریتمی است و چگونه این تصمیمات مورد بررسی قرار میگیرند.

مدیریت ریسک شهرت پیش از وقوع بحران

منتظر نمانید تا یک الگوریتم شکست بخورد و سپس اقدام کنید. ریسک شهرت باید پیشبینی شود، نه فقط پس از وقوع. ابزارهای هوش مصنوعی میتوانند برای شناسایی تغییرات در احساسات عمومی قبل از شدت گرفتن آنها کمک کنند. این ابزارها میتوانند رسانههای اجتماعی، اخبار و نظرات آنلاین را اسکن کرده و الگوهایی که نشاندهنده یک مشکل در حال ظهور است را شناسایی کنند.

ملاحظات اخلاقی که نباید نادیده گرفته شوند

الگوریتمها هیچگاه بیطرف نیستند. آنها بازتاب دادههایی هستند که بر اساس آنها آموزش دیدهاند و اولویتهای افرادی که آنها را طراحی کردهاند. هنگامی که دادهها مغرضانه یا ناقص باشند، نتایج میتوانند تبعیضآمیز باشند. شرکتها باید مسئولیت نتایج الگوریتمهای خود را بپذیرند و سیستمهایی طراحی کنند که عدالت و شمولیت را اولویت دهند.

درگیر کردن ذینفعان در مکالمه

یکی از جنبههای نادیده گرفته شده مسئولیتپذیری الگوریتمی، ارتباطات است. ذینفعان میخواهند بفهمند چگونه الگوریتمها بر آنها تأثیر میگذارند. شرکتها باید بهطور شفاف توضیح دهند که چگونه الگوریتمها کار میکنند، چه دادههایی استفاده میکنند و چگونه عدالت را اندازهگیری میکنند. این تعاملات به صورت مداوم باید صورت گیرد تا اعتبار شرکت حفظ شود.

در دوران دیجیتال، شهرت تنها بر اساس گفتههای مردم شکل نمیگیرد، بلکه از آنچه الگوریتمها میگویند و نمیگویند نیز تأثیر میپذیرد. برای پیشرفت، شرکتها باید ساختارهای داخلیای ایجاد کنند که از شفافیت و نظارت حمایت کند. اعتماد با اقدامهای اخلاقی مداوم و به موقع ساخته میشود و شرکتهایی که این نکته را درک کرده و عمل کنند، اعتماد عمومی را به دست خواهند آورد و حفظ خواهند کرد.

انتهای پیام/

نظر بدهید